概述

Hive 的元数据信息通常存储在关系型数据库中,常用MySQL数据库作为元数据库管理。上一篇hive的安装也是将元数据信息存放在MySQL数据库中。

Hive的元数据信息在MySQL数据中有57张表

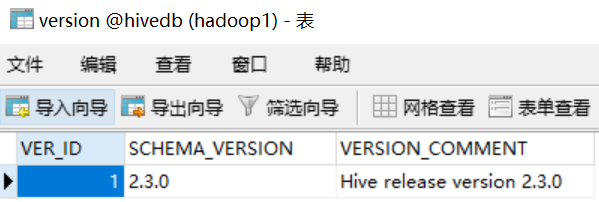

一、存储Hive版本的元数据表(VERSION)

VERSION -- 查询版本信息

该表比较简单,但很重要。

| VER_ID | SCHEMA_VERSION | VERSION_COMMENT |

| ID主键 | Hive版本 | 版本说明 |

| 1 | 0.13.0 | Set by MetaStore |

如果该表出现问题,根本进入不了Hive-Cli。

比如该表不存在,当启动Hive-Cli时候,就会报错”Table ‘hive.version’ doesn’t exist”。

二、Hive数据库相关的元数据表(DBS、DATABASE_PARAMS)

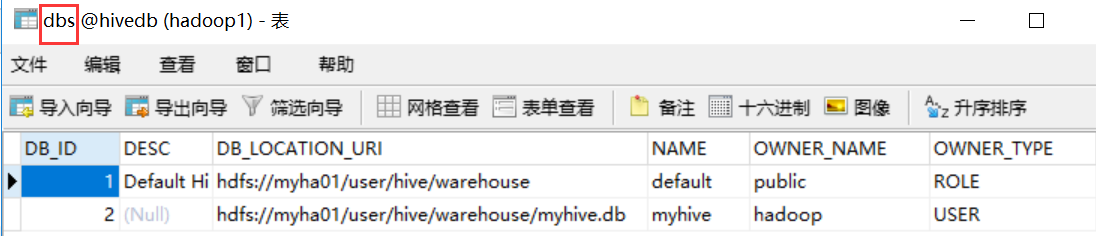

1、DBS

DBS -- 存储Hive中所有数据库的基本信息

| 元数据表字段 | 说明 | 示例数据 |

| DB_ID | 数据库ID | 2 |

| DESC | 数据库描述 | 测试库 |

| DB_LOCATION_URI | 数据库HDFS路径 | hdfs://namenode/user/hive/warehouse/lxw1234.db |

| NAME | 数据库名 | lxw1234 |

| OWNER_NAME | 数据库所有者用户名 | lxw1234 |

| OWNER_TYPE | 所有者角色 | USER |

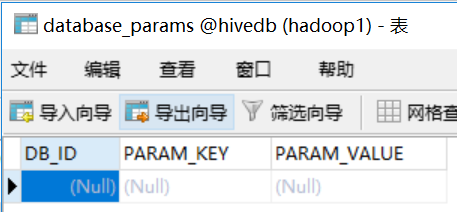

2、DATABASE_PARAMS

DATABASE_PARAMS --该表存储数据库的相关参数,在CREATE DATABASE时候用

WITH DBPROPERTIES (property_name=property_value, …)指定的参数。

| 元数据表字段 | 说明 | 示例数据 |

| DB_ID | 数据库ID | 2 |

| PARAM_KEY | 参数名 | createdby |

| PARAM_VALUE | 参数值 | lxw1234 |

注意:

DBS和DATABASE_PARAMS这两张表通过DB_ID字段关联。

三、Hive表和视图相关的元数据表

主要有TBLS、TABLE_PARAMS、TBL_PRIVS,这三张表通过TBL_ID关联。

1、TBLS

该表中存储Hive表、视图、索引表的基本信息。

| 元数据表字段 | 说明 | 示例数据 |

| TBL_ID | 表ID | 1 |

| CREATE_TIME | 创建时间 | 1436317071 |

| DB_ID | 数据库ID | 2,对应DBS中的DB_ID |

| LAST_ACCESS_TIME | 上次访问时间 | 1436317071 |

| OWNER | 所有者 | liuxiaowen |

| RETENTION | 保留字段 | 0 |

| SD_ID | 序列化配置信息 | 86,对应SDS表中的SD_ID |

| TBL_NAME | 表名 | lxw1234 |

| TBL_TYPE | 表类型 | MANAGED_TABLE、EXTERNAL_TABLE、INDEX_TABLE、VIRTUAL_VIEW |

| VIEW_EXPANDED_TEXT | 视图的详细HQL语句 | select `lxw1234`.`pt`, `lxw1234`.`pcid` from `liuxiaowen`.`lxw1234` |

| VIEW_ORIGINAL_TEXT | 视图的原始HQL语句 | select * from lxw1234 |

2、TABLE_PARAMS

该表存储表/视图的属性信息。

| 元数据表字段 | 说明 | 示例数据 |

| TBL_ID | 表ID | 1 |

| PARAM_KEY | 属性名 | totalSize、numRows、EXTERNAL |

| PARAM_VALUE | 属性值 | 970107336、21231028、TRUE |

3、TBL_PRIVS

该表存储表/视图的授权信息

| 元数据表字段 | 说明 | 示例数据 |

| TBL_GRANT_ID | 授权ID | 1 |

| CREATE_TIME | 授权时间 | 1436320455 |

| GRANT_OPTION | 0 | |

| GRANTOR | 授权执行用户 | liuxiaowen |

| GRANTOR_TYPE | 授权者类型 | USER |

| PRINCIPAL_NAME | 被授权用户 | username |

| PRINCIPAL_TYPE | 被授权用户类型 | USER |

| TBL_PRIV | 权限 | Select、Alter |

| TBL_ID | 表ID | 22,对应TBLS表中的TBL_ID |

四、Hive文件存储信息相关的元数据表

主要涉及SDS、SD_PARAMS、SERDES、SERDE_PARAMS

由于HDFS支持的文件格式很多,而建Hive表时候也可以指定各种文件格式,Hive在将HQL解析成MapReduce时候,需要知道去哪里,使用哪种格式去读写HDFS文件,而这些信息就保存在这几张表中。

1、SDS

该表保存文件存储的基本信息,如INPUT_FORMAT、OUTPUT_FORMAT、是否压缩等。

TBLS表中的SD_ID与该表关联,可以获取Hive表的存储信息。

| 元数据表字段 | 说明 | 示例数据 |

| SD_ID | 存储信息ID | 1 |

| CD_ID | 字段信息ID | 21,对应CDS表 |

| INPUT_FORMAT | 文件输入格式 | org.apache.hadoop.mapred.TextInputFormat |

| IS_COMPRESSED | 是否压缩 | 0 |

| IS_STOREDASSUBDIRECTORIES | 是否以子目录存储 | 0 |

| LOCATION | HDFS路径 | hdfs://namenode/hivedata/warehouse/ut.db/t_lxw |

| NUM_BUCKETS | 分桶数量 | 5 |

| OUTPUT_FORMAT | 文件输出格式 | org.apache.hadoop.hive.ql.io.HiveIgnoreKeyTextOutputFormat |

| SERDE_ID | 序列化类ID | 3,对应SERDES表 |

2、SD_PARAMS

该表存储Hive存储的属性信息,在创建表时候使用

STORED BY ‘storage.handler.class.name’ [WITH SERDEPROPERTIES (…)指定。

|

元数据表字段 |

说明 | 示例数据 |

| SD_ID | 存储配置ID | 1 |

| PARAM_KEY | 存储属性名 | |

| PARAM_VALUE | 存储属性值 |

3、SERDES

该表存储序列化使用的类信息

| 元数据表字段 | 说明 | 示例数据 |

| SERDE_ID | 序列化类配置ID | 1 |

| NAME | 序列化类别名 | |

| SLIB | 序列化类 | org.apache.hadoop.hive.serde2.lazy.LazySimpleSerDe |

4、SERDE_PARAMS

该表存储序列化的一些属性、格式信息,比如:行、列分隔符

| 元数据表字段 | 说明 | 示例数据 |

| SERDE_ID | 序列化类配置ID | 1 |

| PARAM_KEY | 属性名 | field.delim |

| PARAM_VALUE | 属性值 | , |

五、Hive表字段相关的元数据表

主要涉及COLUMNS_V2

1、COLUMNS_V2

该表存储表对应的字段信息。

| 元数据表字段 | 说明 | 示例数据 |

| CD_ID | 字段信息ID | 1 |

| COMMENT | 字段注释 | |

| COLUMN_NAME | 字段名 | pt |

| TYPE_NAME | 字段类型 | string |

| INTEGER_IDX | 字段顺序 | 2 |

六、Hive表分区相关的元数据表

主要涉及PARTITIONS、PARTITION_KEYS、PARTITION_KEY_VALS、PARTITION_PARAMS

1、PARTITIONS

该表存储表分区的基本信息。

| 元数据表字段 | 说明 | 示例数据 |

| PART_ID | 分区ID | 1 |

| CREATE_TIME | 分区创建时间 | |

| LAST_ACCESS_TIME | 最后一次访问时间 | |

| PART_NAME | 分区名 | pt=2015-06-12 |

| SD_ID | 分区存储ID | 21 |

| TBL_ID | 表ID | 2 |

2、PARTITION_KEYS

该表存储分区的字段信息。

| 元数据表字段 | 说明 | 示例数据 |

| TBL_ID | 表ID | 2 |

| PKEY_COMMENT | 分区字段说明 | |

| PKEY_NAME | 分区字段名 | pt |

| PKEY_TYPE | 分区字段类型 | string |

| INTEGER_IDX | 分区字段顺序 | 1 |

3、PARTITION_KEY_VALS

该表存储分区字段值。

| 元数据表字段 | 说明 | 示例数据 |

| PART_ID | 分区ID | 2 |

| PART_KEY_VAL | 分区字段值 | 2015-06-12 |

| INTEGER_IDX | 分区字段值顺序 | 0 |

4、PARTITION_PARAMS

该表存储分区的属性信息。

| 元数据表字段 | 说明 | 示例数据 |

| PART_ID | 分区ID | 2 |

| PARAM_KEY | 分区属性名 | numFiles、numRows |

| PARAM_VALUE | 分区属性值 | 15、502195 |

七、其他不常用的元数据表

- DB_PRIVS

数据库权限信息表。通过GRANT语句对数据库授权后,将会在这里存储。

- IDXS

索引表,存储Hive索引相关的元数据

- INDEX_PARAMS

索引相关的属性信息。

- TAB_COL_STATS

表字段的统计信息。使用ANALYZE语句对表字段分析后记录在这里。

- TBL_COL_PRIVS

表字段的授权信息

- PART_PRIVS

分区的授权信息

- PART_COL_STATS

分区字段的统计信息。

- PART_COL_PRIVS

分区字段的权限信息。

- FUNCS

用户注册的函数信息

- FUNC_RU

用户注册函数的资源信息

总结:

常用的几个:

SELECT * FROM `dbs` 数据库表 SELECT * FROM `tbls` hive表 db_id表示 数据库id SELECT * FROM `sds` WHERE cd_id = 23171 cd_id是表id,sds里是表的属性信息,比如:location 分区 input_format 信息 SELECT * FROM `columns_v2` WHERE cd_id = 23171 列名表, cd_id表示 表id, 展示表下所有的列 SELECT * FROM `partitions` WHERE tbl_id = 23171 分区表, tbl_id 表示表id sd_id表示partition分区的id 每一个分区一个id

案例:

先在表 TBLS中根据表名获取序列化信息a

然后去 文件存储基本信息表(SDS)中根据a序列化值得到所有的列CD_ID

然后在去 列表(COLUMNS_V2)中根据上面的列CD_ID获取列名和类型信息

public void mysqlSelect(String act) throws SQLException {

Connection conn;

String url = "jdbc:mysql://192.168.201.300:3316/hive";

String user = "hive_read";

String password = "sdfsfdfddfdfdfdfdf";

conn = DriverManager.getConnection(url, user, password);

Statement stmt = conn.createStatement(); //创建Statement对象

System.out.println("成功连接到数据库!");

String tbname = "stg_log_" + act;

String sql = "select COLUMN_NAME,TYPE_NAME from COLUMNS_V2 where CD_ID=(select CD_ID from SDS where SD_ID=(select SD_ID from TBLS where TBL_NAME=" + "'" + tbname + "'));"; //要执行的SQL

ResultSet rs = stmt.executeQuery(sql);//创建数据对象

ft.clear();

while (rs.next()) {

ft.put(rs.getString(1), rs.getString(2));

}

rs.close();

stmt.close();

conn.close();

}

String sql = "select COLUMN_NAME from COLUMNS_V2 where CD_ID= -- 根据 表ID(CD_ID)去表COLUMNS_V2获取列名 ( select CD_ID from SDS where SD_ID= -- 根据表序列化ID(SD_ID)去SDS获取表ID(CD_ID) ( select SD_ID from TBLS where TBL_NAME=" + "'" + user + "'"+ "and DB_ID=(21895) -- 根据库名表名获取表主键 ) ) ORDER BY INTEGER_IDX ASC;"; // 根据表的列排序ID进行排序 结果: 展示表user下所有的列

相关推荐

datax数据从hive表导入mysql表,数据缺失解决

spring-boot集成mybatis+druid实现 hive/mysql多数据源切换,用mysql数据库作为用户验证库以及用户信息库,hive作为数据可视化源库。

pyflink将mysql数据直接插入hive,由此可以延伸出pyflink实现hive关联mysql

新手学习大数据搭建环境所需要安装资料包,其中包括hive-mysql安装包,HIVE连接mysql驱动。其中包括 apache-hive-1.2.1-bin.tar.gz MySQL-client-5.6.24-1.el6.x86_64.rpm mysql-connector-java-5.1.27.tar.gz MySQL-...

1.将Mysql中的数据迁移到Hdfs文件系统中,然后通过Hive加载HDFS文件系统中的数据值 2.将Hive中的数据迁移到指定Mysql数据库中 注意点: 1.数据迁移的过程中,由于hive的Null值存储为"\N",Mysql存储为NULL值,二者...

Hive.sql

centos 下hive连接mysql驱动 ,mysql-connector-java-8.0.26-1.el7.noarch. 使用方法: 1.下载本rpm文件后,上传至你的服务器(虚拟机) 2. rpm -ivh mysql-connector-java-8.0.26-1.el7.noarch进行安装 3.安装完成...

{ job: { setting: { speed: { channel: 1 }, errorLimit: { record: 0, percentage: 0.02 } }, content: [ { reader: {

简单的spark加载HIVE MYSQL 数据,以及简单的进行往mysql,hive写入数据

hive-mysqlhive-mysql

springboot +hive+mysql 多数据源切换 个人写了一个demo 并测试通过 下载地址

通过mysql> source XXXXX\hive-schema-3.1.0.mysql.sql初始化元数据

mysql安装包,mysql外界数据库作为存储hive元数据的存储介质,它的存在,方便hive用户根据自身的需求对数据进行分析处理。

Hive表生成工具,Hive表生成工具Hive表生成工具

可以从hive元数据生成建表语句的资源。包括表结构、分区等信息

很多刚入门的同学找不到版本对应关系,这里从官网整理下来,供大家参考 hadoop、hbase、hive版本对应关系.新手指导hadoop、hbase、hive版本对应关系查找表

mysql数据抽取,自动生成hive建表语句,只需要输入表名即可

Hive、MySQL、HBase数据互导的操作步骤

本文主要给大家介绍了关于Mysql元数据生成Hive建表语句注释脚本的相关内容,分享出来供大家参考学习,下面话不多说了,来一起看看详细的介绍: 最近在将数据从Mysql 等其他关系型数据库 抽取到Hive 表中时,需要同步...

apache-hive-1.2.1-bin.tar.gz mysql-connector-java-5.1.6-bin 用于安装Hive并使用MySQL作为元数据库