NettyжПРдЊЫеЉВж≠•зЪДгАБдЇЛдїґй©±еК®зЪДзљСзїЬеЇФзФ®з®ЛеЇПж°ЖжЮґеТМеЈ•еЕЈпЉМзФ®дї•ењЂйАЯеЉАеПСйЂШжАІиГљгАБйЂШеПѓйЭ†жАІзЪДзљСзїЬжЬНеК°еЩ®еТМеЃҐжИЈзЂѓз®ЛеЇП[еЃШжЦєеЃЪдєЙ]пЉМжХідљУжЭ•зЬЛеЕґ

еМЕеРЂдЇЖдї•дЄЛеЖЕеЃєпЉЪ1.жПРдЊЫдЇЖдЄ∞еѓМзЪДеНПиЃЃзЉЦиІ£з†БжФѓжМБпЉМ2.еЃЮзО∞иЗ™жЬЙзЪДbufferз≥їзїЯпЉМеЗПе∞Се§НеИґжЙАеЄ¶жЭ•зЪДжґИиАЧпЉМ3.жХіе•ЧchannelзЪДеЃЮзО∞пЉМ4.еЯЇдЇОдЇЛдїґ

зЪДињЗз®ЛжµБиљђдї•еПКеЃМжХізЪДзљСзїЬдЇЛдїґеУНеЇФдЄОжЙ©е±ХпЉМ5.дЄ∞еѓМзЪДexampleгАВжЬђжЦЗеєґдЄНеѓєNettyеЃЮйЩЕдљњзФ®дЄ≠еПѓиГљеЗЇзО∞зЪДйЧЃйҐШеБЪеИЖжЮРпЉМеП™жШѓдїОдї£з†БиІТеЇ¶еИЖжЮРеЃГзЪДжЮґжЮД

дї•еПКеЃЮзО∞дЄКзЪДдЄАдЇЫеЕ≥йФЃзїЖиКВгАВ

й¶ЦеЕИжЭ•зЬЛдЄЛжЬАе¶ВдљХдљњзФ®Netty(еЕґиЗ™еЄ¶exampleеЊИе•ље±Хз§ЇдЇЖдљњзФ®)пЉМNettyжЩЃйАЪдљњзФ®дЄАиИђжШѓйАЪињЗBootStrapжЭ•еРѓ

еК®пЉМBootStrapдЄїи¶БеИЖдЄЇдЄ§з±їпЉЪ1.йЭҐеРСињЮжО•(TCP)зЪДBootStrap(ClientBootStrapеТМ

ServerBootstrap),2.йЭЮйЭҐеРСињЮжО•(UDP) зЪД(ConnectionlessBootstrap)гАВ

NettyжХідљУжЮґжЮДеЊИжЄЕжЩ∞зЪДеИЖжИР2дЄ™йГ®еИЖпЉМChannelFactory

еТМChannelPipelineFactory,еЙНиАЕдЄїи¶БзФЯдЇІзљСзїЬйАЪдњ°зЫЄеЕ≥зЪДChannelеЃЮдЊЛеТМChannelSinkеЃЮдЊЛпЉМNettyжПРдЊЫзЪД

ChannelFactoryеЃЮзО∞еЯЇжЬђиГље§Яжї°иґ≥зїЭе§ІйГ®еИЖзФ®жИЈзЪДйЬАж±ВпЉМељУзДґдљ†дєЯеПѓдї•еЃЪеИґиЗ™еЈ±зЪДChannelFactory,еРОиАЕдЄїи¶БеЕ≥ж≥®дЇОеЕЈдљУдЉ†иЊУжХ∞жНЃзЪД

е§ДзРЖпЉМеРМжЧґдєЯеМЕжЛђеЕґдїЦжЦєйЭҐзЪДеЖЕеЃєпЉМжѓФе¶ВеЉВеЄЄе§ДзРЖз≠Йз≠ЙпЉМеП™и¶БжШѓдљ†еЄМжЬЫзЪДпЉМдљ†йГљеПѓдї•еЊАйЗМжЈїеК†зЫЄеЇФзЪДhandler,дЄАиИђ

ChannelPipelineFactoryзФ±зФ®жИЈиЗ™еЈ±еЃЮзО∞пЉМеЫ†дЄЇдЉ†иЊУжХ∞жНЃзЪДе§ДзРЖеПКеЕґдїЦжУНдљЬеТМдЄЪеК°еЕ≥иБФжѓФиЊГзіІеѓЖпЉМйЬАи¶БиЗ™еЃЪдєЙе§ДзРЖзЪДhandlerгАВ

зО∞еЬ®пЉМдљњзФ®NettyзЪДж≠•й™§еЃЮйЩЕдЄКеЈ≤зїПйЭЮеЄЄжШОз°ЃдЇЖпЉМжѓФе¶ВйЭҐеРСињЮжО•зЪДNettyжЬНеК°зЂѓеЃҐжИЈзЂѓдљњзФ®пЉМзђђдЄАж≠•пЉЪеЃЮдЊЛеМЦдЄАдЄ™BootStrap,еєґдЄФйАЪињЗжЮД

йА†жЦєж≥ХжМЗеЃЪдЄАдЄ™ChannelFactoryеЃЮзО∞пЉМзђђдЇМж≠•пЉЪеРСbootstrapеЃЮдЊЛж≥®еЖМдЄАдЄ™иЗ™еЈ±еЃЮзО∞зЪДChannelPipelineFactory,

зђђдЄЙж≠•пЉЪе¶ВжЮЬжШѓжЬНеК°еЩ®зЂѓпЉМbootstrap.bind(new

InetSocketAddress(port))пЉМзДґеРОз≠ЙеЊЕеЃҐжИЈзЂѓжЭ•ињЮжО•,е¶ВжЮЬжШѓеЃҐжИЈзЂѓпЉМbootstrap.connect(new

InetSocketAddress(host,port))еПЦеЊЧдЄАдЄ™future,ињЩдЄ™жЧґеАЩNettyдЉЪеОїињЮжО•ињЬз®ЛдЄїжЬЇпЉМеЬ®ињЮжО•еЃМжИРеРОпЉМдЉЪеПСиµЈз±їеЮЛдЄЇ

CONNECTEDзЪДChannelStateEventпЉМеєґдЄФеЉАеІЛеЬ®дљ†иЗ™еЃЪдєЙзЪДPipelineйЗМйЭҐжµБиљђпЉМе¶ВжЮЬдљ†ж≥®еЖМзЪДhandlerжЬЙињЩдЄ™дЇЛдїґзЪДеУНеЇФ

жЦєж≥ХзЪДиѓЭйВ£дєИе∞±дЉЪи∞ГзФ®еИ∞ињЩдЄ™жЦєж≥ХгАВеЬ®ж≠§дєЛеРОе∞±жШѓжХ∞жНЃзЪДдЉ†иЊУдЇЖгАВдЄЛйЭҐжШѓдЄАдЄ™зЃАеНХеЃҐжИЈзЂѓзЪДдї£з†БиІ£иѓїгАВ

ClientBootstrap bootstrap =

new

ClientBootstrap(

|

new

NioClientSocketChannelFactory(

|

Executors.newCachedThreadPool(),

|

Executors.newCachedThreadPool()));

|

bootstrap.setPipelineFactory(

new

FactorialClientPipelineFactory(count));

|

ChannelFuture connectFuture =

|

bootstrap.connect(

new

InetSocketAddress(host, port));

|

Channel channel = connectFuture.awaitUninterruptibly().getChannel();

|

FactorialClientHandler handler =

|

(FactorialClientHandler) channel.getPipeline().getLast();

|

System.err.format(

|

"Factorial of %,d is: %,d"

, count, handler.getFactorial());

|

NettyжПРдЊЫдЇЖNIOдЄОBIO(OIO)дЄ§зІНж®°еЉПе§ДзРЖињЩдЇЫйАїиЊСпЉМеЕґдЄ≠NIOдЄїи¶БйАЪињЗдЄАдЄ™BOSSзЇњз®Ле§ДзРЖз≠ЙеЊЕйУЊжО•зЪДжО•еЕ•пЉМиЛ•еє≤дЄ™WORKERзЇњз®Л

(дїОworkerзЇњз®Л汆дЄ≠жМСйАЙдЄАдЄ™иµЛзїЩChannelеЃЮдЊЛпЉМеЫ†дЄЇChannelеЃЮдЊЛжМБжЬЙзЬЯж≠£зЪД

javaзљСзїЬеѓєи±°)жО•ињЗBOSSзЇњз®ЛйАТдЇ§ињЗжЭ•зЪДCHANNELињЫи°МжХ∞жНЃиѓїеЖЩеєґдЄФиІ¶еПСзЫЄеЇФдЇЛдїґдЉ†йАТзїЩpipelineињЫи°МжХ∞жНЃе§ДзРЖпЉМиАМBIO(OIO)жЦєеЉП

жЬНеК°еЩ®зЂѓиЩљзДґињШжШѓйАЪињЗдЄАдЄ™BOSSзЇњз®ЛжЭ•е§ДзРЖз≠ЙеЊЕйУЊжО•зЪДжО•еЕ•пЉМдљЖжШѓеЃҐжИЈзЂѓжШѓзФ±дЄїзЇњз®ЛзЫіжО•connect,еП¶е§ЦеЖЩжХ∞жНЃC/SдЄ§зЂѓйГљжШѓзЫіжО•дЄїзЇњз®ЛеЖЩпЉМиАМжХ∞жНЃиѓї

жУНдљЬжШѓйАЪињЗдЄАдЄ™WORKER зЇњз®ЛBLOCKжЦєеЉПиѓїеПЦ(дЄАзЫіз≠ЙеЊЕпЉМзЫіеИ∞иѓїеИ∞жХ∞жНЃпЉМйЩ§йЭЮchannelеЕ≥йЧ≠)гАВ

зљСзїЬеК®дљЬељТзїУеИ∞жЬАзЃАеНХе∞±жШѓжЬНеК°еЩ®зЂѓbind->accept->read->write,еЃҐжИЈзЂѓ

connect->read->write,дЄАиИђbindжИЦиАЕconnectеРОдЉЪжЬЙе§Ъжђ°readгАБwriteгАВињЩзІНзЙєжАІеѓЉ

иЗіпЉМbind,acceptдЄОread,writeзЪДзЇњз®ЛеИЖз¶їпЉМconnectдЄОreadгАБwriteзЇњз®ЛеИЖз¶їпЉМињЩж†ЈеБЪзЪДе•ље§Де∞±жШѓжЧ†иЃЇжШѓжЬНеК°еЩ®зЂѓињШжШѓеЃҐжИЈ

зЂѓеРЮеРРйЗПе∞ЖжЬЙжХИеҐЮе§ІпЉМдї•дЊњеЕЕеИЖеИ©зФ®жЬЇеЩ®зЪДе§ДзРЖиГљеКЫпЉМиАМдЄНжШѓеН°еЬ®зљСзїЬињЮжО•дЄКпЉМдЄНињЗдЄАжЧ¶жЬЇеЩ®е§ДзРЖиГљеКЫеЕЕеИЖеИ©зФ®еРОпЉМињЩзІНжЦєеЉПеПНиАМеПѓиГљдЉЪеЫ†дЄЇињЗдЇОйҐСзєБзЪДзЇњз®ЛеИЗжНҐеѓЉ

иЗіжАІиГљжНЯ姱иАМеЊЧдЄНеБње§±пЉМеєґдЄФињЩзІНе§ДзРЖж®°еЮЛе§НжЭВеЇ¶жѓФиЊГйЂШгАВ

йЗЗзФ®дїАдєИж†ЈзЪДзљСзїЬдЇЛдїґеУНеЇФе§ДзРЖжЬЇеИґеѓєдЇОзљСзїЬеРЮеРРйЗПжШѓйЭЮеЄЄйЗНи¶БзЪДпЉМNettyйЗЗзФ®зЪДжШѓж†ЗеЗЖзЪДSEDAпЉИStaged Event-Driven

ArchitectureпЉЙжЮґжЮД[http://en.wikipedia.org/wiki/

Staged_event-driven_architecture]пЉМеЕґжЙАиЃЊиЃ°зЪДдЇЛдїґз±їеЮЛпЉМдї£и°®дЇЖзљСзїЬдЇ§дЇТзЪДеРДдЄ™йШґжЃµпЉМеєґдЄФеЬ®жѓПдЄ™йШґжЃµеПСзФЯжЧґпЉМиІ¶еПСзЫЄеЇФ

дЇЛдїґдЇ§зїЩеИЭеІЛеМЦжЧґзФЯжИРзЪДpipelineеЃЮдЊЛињЫи°Ме§ДзРЖгАВдЇЛдїґе§ДзРЖйГљжШѓйАЪињЗChannelsз±їзЪДйЭЩжАБжЦєж≥Хи∞ГзФ®еЉАеІЛзЪДпЉМе∞ЖдЇЛдїґгАБchannelдЉ†йАТзїЩ

channelжМБжЬЙзЪДPipelineињЫи°Ме§ДзРЖпЉМChannelsз±їеЗ†дєОжЙАжЬЙжЦєж≥ХйГљдЄЇйЭЩжАБпЉМжПРдЊЫдЄАзІНProxyзЪДжХИжЮЬ(жХідЄ™еЈ•з®ЛйЗМжЧ†иЃЇдљХжЧґдљХеЬ∞йГљеПѓдї•и∞ГзФ®

еЕґйЭЩжАБжЦєж≥ХиІ¶еПСеЫЇеЃЪзЪДдЇЛдїґжµБиљђ,дљЖеЕґжЬђиЇЂеєґдЄНеЕ≥ж≥®еЕЈдљУзЪДе§ДзРЖжµБз®Л)гАВ

ChannelsйГ®еИЖдЇЛдїґжµБиљђйЭЩжАБжЦєж≥Х

1пЉОfireChannelOpen 2пЉОfireChannelBound 3пЉОfireChannelConnected

4пЉОfireMessageReceived 5пЉОfireWriteComplete 6пЉОfireChannelInterestChanged

7пЉОfireChannelDisconnected 8пЉОfireChannelUnbound 9пЉОfireChannelClosed 10.fireExceptionCaught 11.fireChildChannelStateChanged

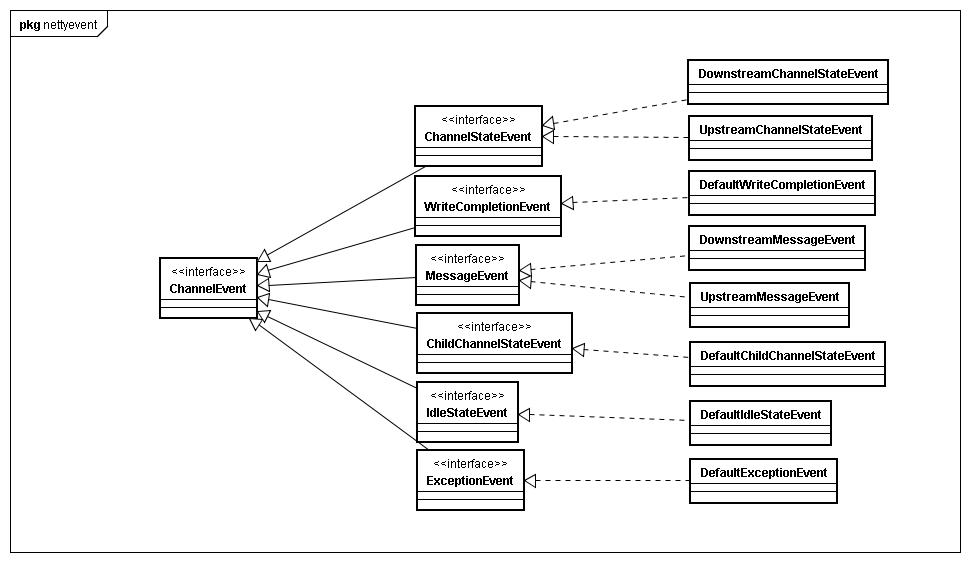

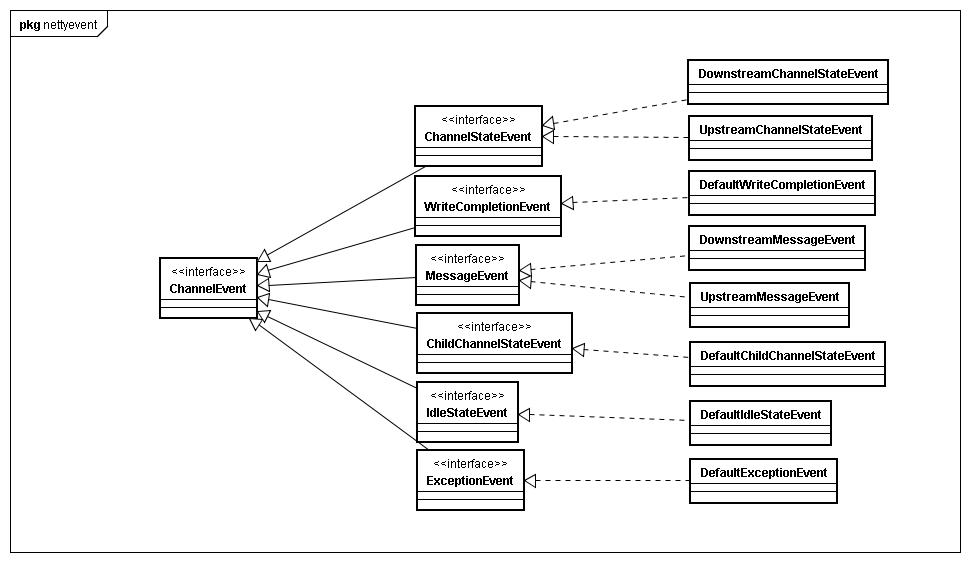

NettyжПРдЊЫдЇЖеЕ®йЭҐиАМеПИдЄ∞еѓМзЪДзљСзїЬдЇЛдїґз±їеЮЛпЉМеЕґе∞ЖjavaдЄ≠зЪДзљСзїЬдЇЛдїґеИЖдЄЇдЇЖдЄ§зІНз±їеЮЛUpstreamеТМDownstreamгАВдЄАиИђжЭ•

иѓіпЉМUpstreamз±їеЮЛзЪДдЇЛдїґдЄїи¶БжШѓзФ±зљСзїЬеЇХе±ВеПНй¶ИзїЩNettyзЪДпЉМжѓФе¶ВmessageReceived,channelConnectedз≠ЙдЇЛдїґпЉМиАМ

Downstreamз±їеЮЛзЪДдЇЛдїґжШѓзФ±ж°ЖжЮґиЗ™еЈ±еПСиµЈзЪДпЉМжѓФе¶Вbind,write,connect,closeз≠ЙдЇЛдїґгАВ

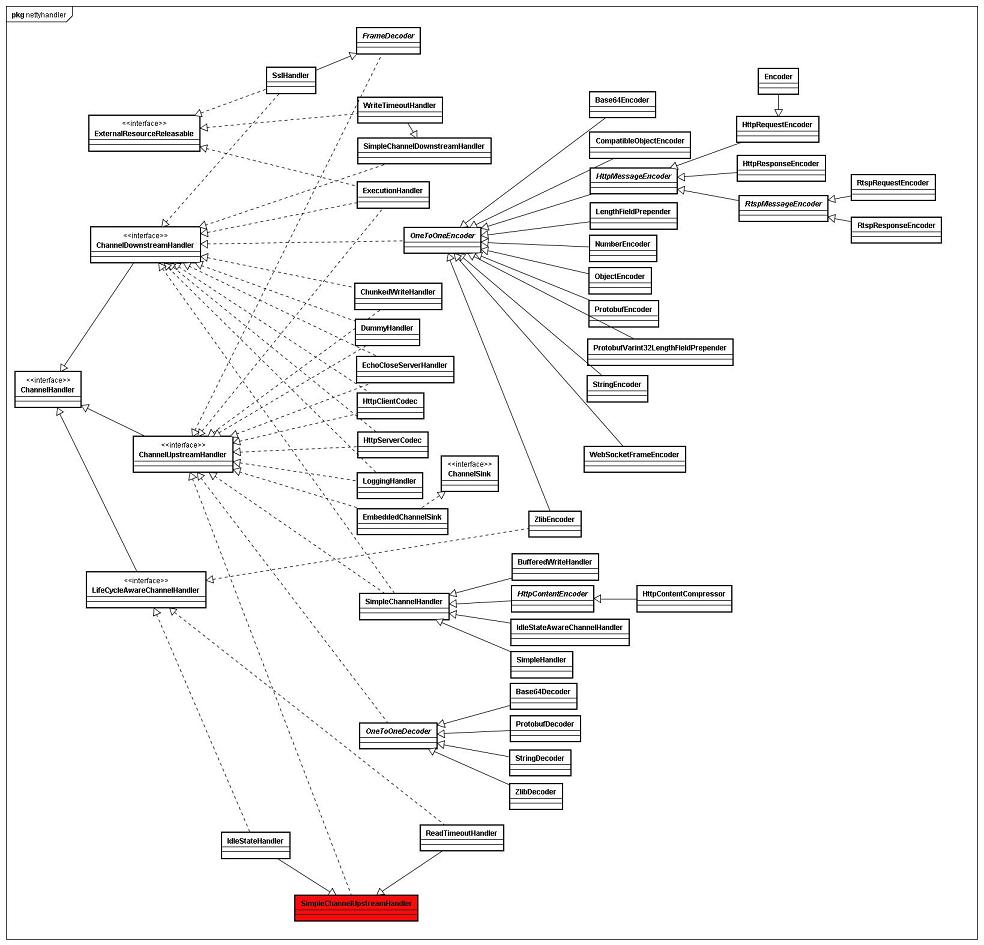

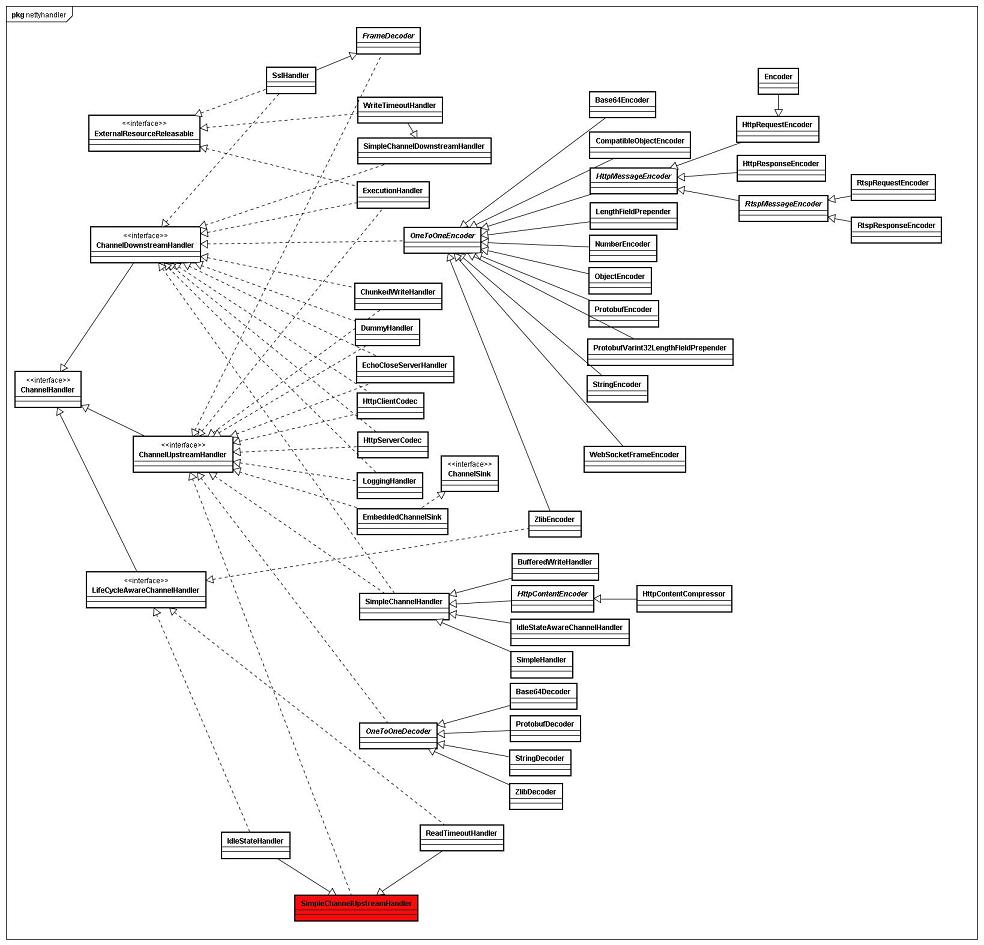

NettyзЪДUpstreamеТМDownstreamзљСзїЬдЇЛдїґз±їеЮЛзЙєжАІдєЯдљњдЄАдЄ™HandlerеИЖдЄЇдЇЖ3зІНз±їеЮЛпЉМдЄУйЧ®е§ДзРЖUpstream,дЄУйЧ®е§ДзРЖ

Downstream,еРМжЧґе§ДзРЖUpstream,DownstreamгАВеЃЮзО∞жЦєеЉПжШѓжЯРдЄ™еЕЈдљУHandlerйАЪињЗзїІжЙњ

ChannelUpstreamHandlerеТМChannelDownstreamHandlerз±їжЭ•ињЫи°МеМЇеИЖгАВPipeLineеЬ®

DownstreamжИЦиАЕUpstreamз±їеЮЛзЪДзљСзїЬдЇЛдїґеПСзФЯжЧґпЉМдЉЪи∞ГзФ®еМєйЕНдЇЛдїґз±їеЮЛзЪДHandlerеУНеЇФињЩзІНи∞ГзФ®гАВChannelPipelineзїіжМБ

жЬЙжЙАжЬЙhandlerжЬЙеЇПйУЊи°®пЉМеєґдЄФзФ±handlerиЗ™иЇЂжОІеИґжШѓеР¶зїІзї≠жµБиљђеИ∞дЄЛдЄАдЄ™handler(ctx.sendDownstream(e),ињЩж†ЈиЃЊ

иЃ°жЬЙдЄ™е•ље§Де∞±жШѓйЪПжЧґзїИж≠ҐжµБиљђпЉМдЄЪеК°зЫЃзЪДиЊЊеИ∞жЧ†йЬАзїІзї≠жµБиљђеИ∞дЄЛдЄАдЄ™handler)гАВдЄЛйЭҐзЪДдї£з†БжШѓеПЦеЊЧдЄЛдЄАдЄ™е§ДзРЖDownstreamдЇЛдїґзЪДе§ДзРЖеЩ®гАВ

DefaultChannelHandlerContext realCtx = ctx;

|

while

(!realCtx.canHandleUpstream()) {

|

realCtx = realCtx.next;

|

if

(realCtx ==

null

) {

|

return

null

;

|

е¶ВжЮЬжШѓдЄАдЄ™зљСзїЬдЉЪиѓЭжЬАжЬЂзЂѓзЪДдЇЛдїґпЉМжѓФе¶ВmessageRecieveпЉМйВ£дєИеПѓиГљеЬ®жЯРдЄ™handlerйЗМйЭҐе∞±зЫіжО•зїУжЭЯжХідЄ™дЉЪиѓЭпЉМеєґжККжХ∞жНЃдЇ§зїЩдЄКе±ВеЇФ

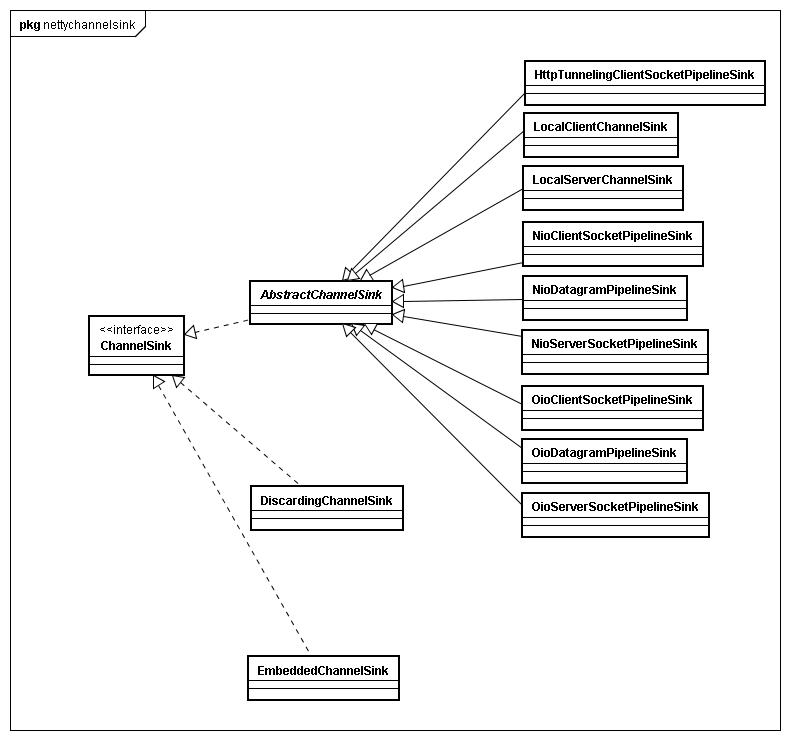

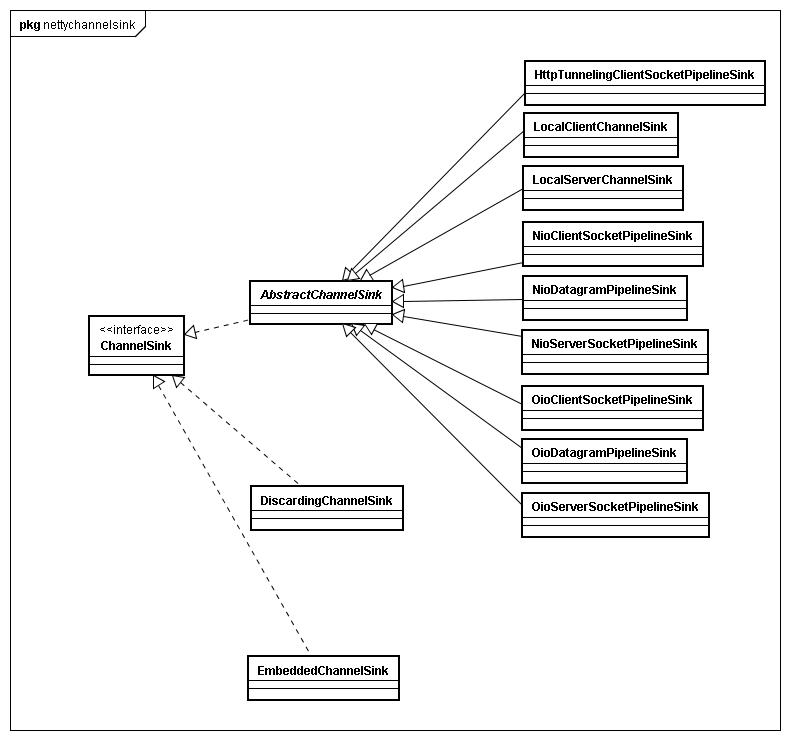

зФ®пЉМдљЖжШѓе¶ВжЮЬжШѓзљСзїЬдЉЪиѓЭзЪДдЄ≠йАФдЇЛдїґпЉМжѓФе¶ВconnectдЇЛдїґпЉМйВ£дєИељУиІ¶еПСconnectдЇЛдїґжЧґпЉМзїПињЗpipelineжµБиљђпЉМжЬАзїИдЉЪеИ∞иЊЊжМВиљљ

pipelineжЬАеЇХдЄЛзЪДChannelSinkеЃЮдЊЛдЄ≠пЉМињЩз±їеЃЮдЊЛдЄїи¶БдљЬзФ®е∞±жШѓеПСйАБиѓЈж±ВеТМжО•жФґиѓЈж±ВпЉМдї•еПКжХ∞жНЃзЪДиѓїеЖЩжУНдљЬгАВ

NIOжЦєеЉПChannelSinkдЄАиИђдЉЪжЬЙ1дЄ™BOSSеЃЮдЊЛ(implements

Runnable)пЉМдї•еПКиЛ•еє≤дЄ™workerеЃЮдЊЛпЉИдЄНиЃЊзљЃйїШиЃ§дЄЇcpu

cores*2дЄ™workerпЉЙпЉМињЩеЬ®еЙНйЭҐеЈ≤зїПжПРиµЈињЗпЉМBOSSзЇњз®ЛеЬ®еЃҐжИЈзЂѓз±їеЮЛзЪДChannelSinkеТМжЬНеК°еЩ®зЂѓз±їеЮЛзЪДChannelSinkиІ¶еПСжЭ°

дїґдЄНдЄАж†ЈпЉМеЃҐжИЈзЂѓз±їеЮЛзЪДBOSSзЇњз®ЛжШѓеЬ®еПСзФЯconnectдЇЛдїґжЧґеРѓеК®пЉМдЄїи¶БзЫСеРђconnectжШѓеР¶жИРеКЯпЉМе¶ВжЮЬжИРеКЯпЉМе∞ЖеРѓеК®дЄАдЄ™workerзЇњз®Л,е∞Ж

connectedзЪДchannelдЇ§зїЩињЩдЄ™зЇњз®ЛзїІзї≠дЄЛйЭҐзЪДеЈ•дљЬпЉМиАМжЬНеК°еЩ®зЂѓзЪДBOSSзЇњз®ЛжШѓеПСзФЯеЬ®bindдЇЛдїґжЧґеРѓеК®пЉМеЃГзЪДеЈ•дљЬдєЯзЫЄеѓєжѓФиЊГзЃАеНХпЉМеѓєдЇО

channel.socket().accept()ињЫжЭ•зЪДиѓЈж±ВеРСNioworkerињЫи°МеЈ•дљЬеИЖйЕНеН≥еПѓгАВињЩйЗМйЬАи¶БжПРеИ∞зЪДжШѓпЉМServerзЂѓ

ChannelSinkеЃЮзО∞жѓФиЊГзЙєеИЂпЉМжЧ†иЃЇжШѓNioServerSocketPipelineSink

ињШжШѓOioServerSocketPipelineSinkзЪДeventSunkжЦєж≥ХеЃЮзО∞йГље∞ЖchannelеИЖдЄЇ

ServerSocketChannelеТМSocketChannelеИЖеЉАе§ДзРЖгАВињЩдЄїи¶БеОЯеЫ†жШѓBossзЇњз®Лaccept()дЄАдЄ™жЦ∞зЪДињЮжО•зФЯжИРдЄАдЄ™

SocketChannelдЇ§зїЩWorkerињЫи°МжХ∞жНЃжО•жФґгАВ

public

void

eventSunk(

|

ChannelPipeline pipeline, ChannelEvent e)

throws

Exception {

|

Channel channel = e.getChannel();

|

if

(channel

instanceof

NioServerSocketChannel) {

|

handleServerSocket(e);

|

}

else

if

(channel

instanceof

NioSocketChannel) {

|

handleAcceptedSocket(e);

|

NioWorker worker = nextWorker();

|

worker.register(

new

NioAcceptedSocketChannel(

|

channel.getFactory(), pipeline, channel,

|

NioServerSocketPipelineSink.

this

, acceptedSocket,

|

worker, currentThread),

null

);

|

еП¶е§ЦдЄ§иАЕеЃЮдЊЛеМЦжЧґйГљдЉЪиµ∞дЄАйБНе¶ВдЄЛжµБз®ЛпЉЪ

fireChannelOpen(

this

);

|

fireChannelBound(

this

, getLocalAddress());

|

fireChannelConnected(

this

, getRemoteAddress());

|

иАМеѓєеЇФзЪДChannelSinkйЗМйЭҐзЪДе§ДзРЖдї£з†Бе∞±дЄНеРМдЇОServerSocketChannelдЇЖпЉМеЫ†дЄЇиµ∞зЪДжШѓ

handleAcceptedSocketпЉИeпЉЙињЩдЄАеЭЧдї£з†БпЉМдїОйїШиЃ§еЃЮзО∞дї£з†БжЭ•иѓі,еЃЮдЊЛеМЦи∞ГзФ®

fireChannelOpenпЉИthisпЉЙ;fireChannelBoundпЉИthis,getLocalAddress()пЉЙ;fireChannelConnectedпЉИthis,getRemoteAddressпЉИпЉЙпЉЙ

ж≤°жЬЙдїАдєИжДПдєЙпЉМдљЖжШѓеѓєдЇОиЗ™еЈ±еЃЮзО∞зЪДChannelSinkжЬЙзЭАзЙєжЃКжДПдєЙгАВеЕЈдљУзЪДзФ®йАФжИСж≤°еОїдЇЖиІ£пЉМдљЖжШѓеПѓдї•иЃ©зФ®жИЈжПТжЙЛServer

acceptињЮжО•еИ∞еЗЖе§ЗиѓїеЖЩжХ∞жНЃињЩдЄАдЄ™ињЗз®ЛзЪДе§ДзРЖгАВ

case

OPEN:

|

if

(Boolean.FALSE.equals(value)) {

|

channel.worker.close(channel, future);

|

}

|

break

;

|

case

BOUND:

|

case

CONNECTED:

|

if

(value ==

null

) {

|

channel.worker.close(channel, future);

|

}

|

break

;

|

case

INTEREST_OPS:

|

channel.worker.setInterestOps(channel, future, ((Integer) value).intValue());

|

break

;

|

NettyжПРдЊЫдЇЖе§ІйЗПзЪДhandlerжЭ•е§ДзРЖзљСзїЬжХ∞жНЃпЉМдљЖжШѓе§ІйГ®еИЖжШѓCODECзЫЄеЕ≥зЪДпЉМдї•дЊњжФѓжМБе§ЪзІНеНПиЃЃпЉМдЄЛйЭҐдЄАдЄ™еЫЊзїШеИґдЇЖзО∞йШґжЃµNettyжПРдЊЫзЪДHandlers(зЇҐиЙ≤йГ®еИЖдЄНеЃМеЕ®)

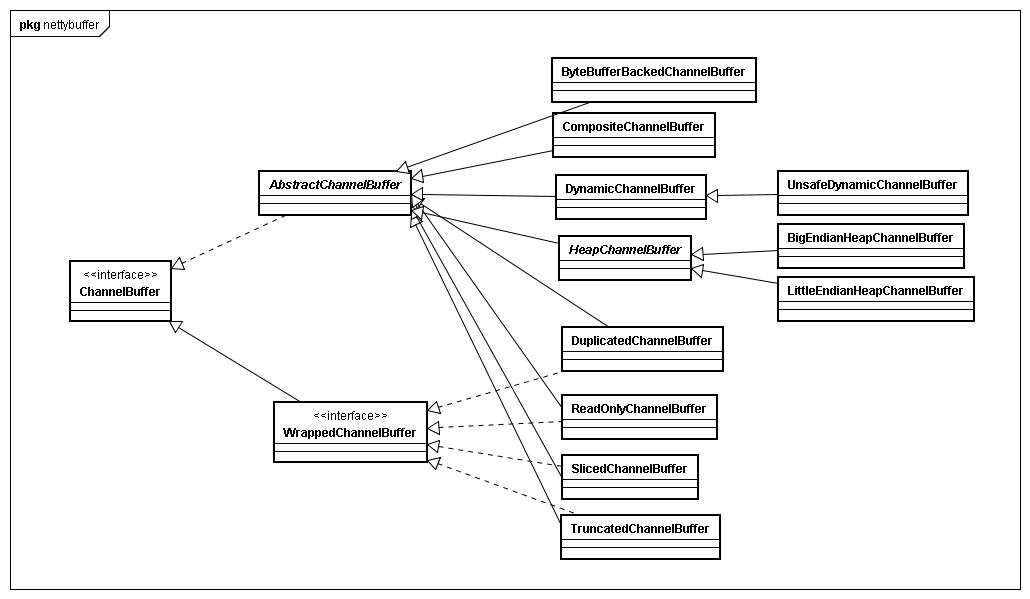

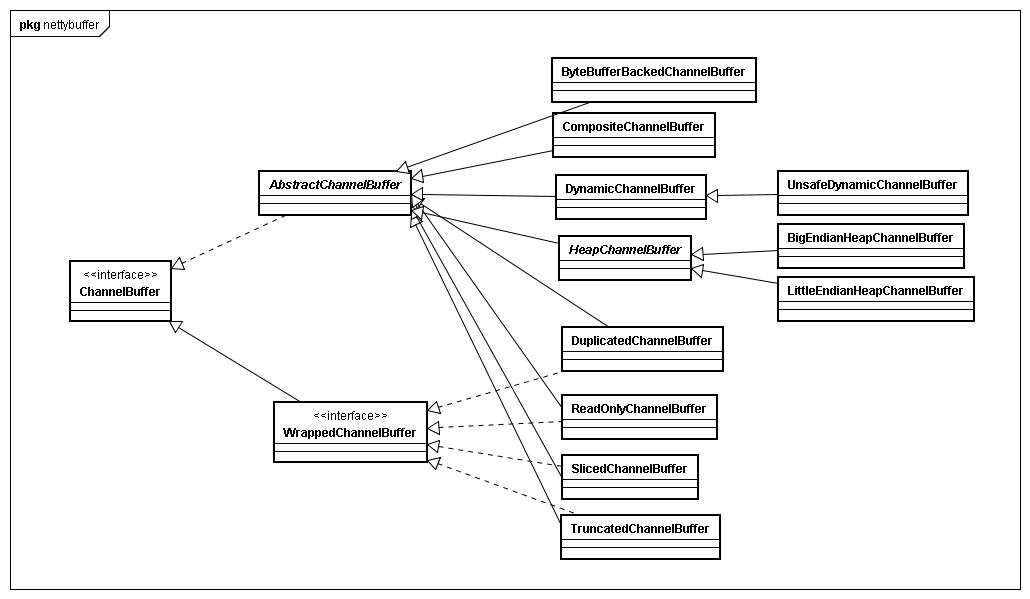

NettyеЃЮзО∞е∞Би£ЕеЃЮзО∞дЇЖиЗ™еЈ±зЪДдЄАе•ЧByteBufferз≥їзїЯпЉМињЩдЄ™ByteBufferз≥їзїЯеѓєе§ЦзїЯдЄАзЪДжО•еП£е∞±жШѓChannelBuffer,ињЩдЄ™

жО•еП£дїОжХідљУдЄКжЭ•иѓіеЃЪдєЙдЇЖдЄ§з±їжЦєж≥ХпЉМдЄАзІНжШѓз±їдЉЉgetXXX(int indexвА¶)пЉМsetXXX(int

indexвА¶)йЬАи¶БжМЗеЃЪеЉАеІЛжУНдљЬbufferзЪДиµЈеІЛдљНзљЃпЉМзЃАеНХзВєжЭ•иѓіе∞±жШѓзЫіжО•жУНдљЬеЇХе±Вbuffer,еєґдЄНзФ®еИ∞NettyзЙєжЬЙзЪДйЂШеПѓйЗНзФ®жАІbufferзЙє

жАІпЉМжЙАдї•NettyеЖЕйГ®еѓєдЇОињЩз±їжЦєж≥Хи∞ГзФ®йЭЮеЄЄе∞СпЉМеП¶е§ЦдЄАзІНжШѓз±їдЉЉreadXXX(),writeXXX()дЄНйЬАи¶БжМЗеЃЪдљНзљЃзЪДbufferжУНдљЬпЉМињЩз±їжЦєж≥ХеЃЮ

зО∞жФЊеЬ®дЇЖAbstractChannelBufferпЉМеЕґдЄїи¶БзЪДзЙєжАІе∞±жШѓзїіжМБbufferзЪДдљНзљЃдњ°жБѓпЉМеМЕжЛђ

readerIndex,writerIndex,дї•еПКеЫЮжЇѓдљЬзФ®зЪДmarkedReaderIndexеТМmarkedWriterIndexпЉМељУзФ®жИЈи∞ГзФ®

readXXX()жИЦиАЕwriteXXX()жЦєж≥ХжЧґпЉМAbstractChannelBufferдЉЪж†єжНЃзїіжК§зЪД

readerIndex,writerIndexиЃ°зЃЧеЗЇиѓїеПЦдљНзљЃпЉМзДґеРОи∞ГзФ®зїІжЙњиЗ™еЈ±зЪДChannelBufferзЪДgetXXX(int

indexвА¶)жИЦиАЕsetXXX(int

indexвА¶)жЦєж≥ХињФеЫЮзїУжЮЬпЉМињЩз±їжЦєж≥ХеЬ®NettyеЖЕйî襀姲йЗПи∞ГзФ®пЉМеЫ†дЄЇињЩдЄ™зЙєжАІжЬАе§ІзЪДе•ље§Де∞±жШѓеЊИжЦєдЊњеЬ∞йЗНзФ®bufferиАМдЄНењЕеОїиієењГиієеКЫзїіжК§index

жИЦиАЕжЦ∞еїЇе§ІйЗПзЪДByteBufferгАВ

еП¶е§ЦWrappedChannelBufferжО•еП£жПРдЊЫзЪДжШѓеѓєChannelBufferзЪДдї£зРЖпЉМдїЦзЪДзФ®йАФиѓізЩљдЇЖе∞±жШѓйЗНзФ®еЇХе±ВbufferпЉМдљЖжШѓдЉЪ

иљђжНҐдЄАдЇЫbufferзЪДиІТиЙ≤пЉМжѓФе¶ВеОЯжЬђжШѓиѓїеЖЩзЪЖеПѓ

пЉМwrapжИРReadOnlyChannelBuffer,йВ£дєИжХідЄ™bufferеП™иГљдљњзФ®readXXX()жИЦиАЕgetXXX()жЦєж≥ХпЉМдєЯе∞±жШѓеП™иѓїпЉМзДґеРО

еЇХе±ВзЪДbufferињШжШѓеОЯжЭ•йВ£дЄ™,еЖНе¶ВдЄАдЄ™еЈ≤зїПињЫи°МињЗиѓїеЖЩзЪДChannelBuffer襀wrapжИРTruncatedChannelBufferпЉМйВ£дєИ

жЦ∞зЪДbufferе∞ЖдЉЪењљзХ•жОЙ襀wrapзЪДbufferеЖЕжХ∞жНЃпЉМеєґдЄФеПѓдї•жМЗеЃЪжЦ∞зЪДwriteIndex,зЫЄељУдЇОsliceеКЯиГљгАВ

NettyеЃЮзО∞дЇЖиЗ™еЈ±зЪДдЄАе•ЧеЃМжХіChannelз≥їзїЯпЉМињЩдЄ™channelиѓіеЃЮеЬ®дєЯжШѓеѓєjava

зљСзїЬеБЪдЇЖдЄАе±Ве∞Би£ЕпЉМеК†дЄКдЇЖSEDAзЙєжАІ(еЯЇдЇОдЇЛдїґеУНеЇФпЉМеЉВж≠•пЉМе§ЪзЇњз®Лз≠Й)гАВеЕґжЬАзїИзЪДзљСзїЬйАЪдњ°ињШжШѓдЊЭйЭ†еЇХдЄЛзЪДjavaзљСзїЬapiгАВжПРеИ∞еЉВж≠•пЉМдЄНеЊЧдЄНжПРеИ∞

NettyзЪДFutureз≥їзїЯпЉМдїОchannelзЪДеЃЪдєЙжЭ•иѓіпЉМwrite,bind,connect,disconnect,unbind,close,

зФЪиЗ≥еМЕжЛђsetInterestOpsз≠ЙжЦєж≥ХйГљдЉЪињФеЫЮдЄАдЄ™channelFutureпЉМињЩињЩдЇЫжЦєж≥Хи∞ГзФ®йГљдЉЪиІ¶еПСзЫЄеЕ≥зљСзїЬдЇЛдїґпЉМеєґдЄФеЬ®pipelineдЄ≠жµБ

иљђгАВChannelеЊИе§ЪжЦєж≥Хи∞ГзФ®еЯЇжЬђдЄКдЄНдЉЪй©ђдЄКе∞±жЙІи°МеИ∞жЬАеЇХе±ВпЉМиАМжШѓиІ¶еПСдЇЛдїґпЉМеЬ®pipelineдЄ≠иµ∞дЄАеЬИпЉМжЬАеРОжЙНеЬ®channelsinkдЄ≠жЙІи°МзЫЄеЕ≥жУН

дљЬпЉМе¶ВжЮЬжґЙеПКзљСзїЬжУНдљЬпЉМйВ£дєИжЬАзїИи∞ГзФ®дЉЪеЫЮеИ∞ChannelдЄ≠пЉМдєЯе∞±жШѓ

serversocketchannel,socketchannel,serversocket,socketз≠ЙjavaеОЯзФЯзљСзїЬapiзЪДи∞ГзФ®пЉМиАМињЩдЇЫ

еЃЮдЊЛе∞±жШѓjbossеЃЮзО∞зЪДchannelжЙАжМБжЬЙзЪД(йГ®еИЖchannel)гАВ

NettyжЦ∞зЙИжЬђеЗЇзО∞дЇЖдЄАдЄ™зЙєжАІzero-copy,ињЩдЄ™жЬЇеИґеПѓдї•дљњжЦЗдїґеЖЕеЃєзЫіжО•дЉ†иЊУеИ∞зЫЄеЇФchannelдЄКиАМдЄНйЬАи¶БйАЪињЗcpuеПВдЄОпЉМдєЯе∞±е∞СдЇЖдЄАжђ°

еЖЕе≠Ше§НеИґгАВNettyеЖЕйГ®ChunkedFile еТМ FileRegion жЮДжИРдЇЖnon zero-copy

еТМzero-copyдЄ§зІН嚥еЉПзЪДжЦЗдїґеЖЕеЃєдЉ†иЊУжЬЇеИґпЉМеЙНиАЕйЬАи¶БCPUеПВдЄОпЉМеРОиАЕж†єжНЃжУНдљЬз≥їзїЯжШѓеР¶жФѓжМБzero-copyе∞ЖжЦЗдїґжХ∞жНЃдЉ†иЊУеИ∞зЙєеЃЪ

channel,е¶ВжЮЬжУНдљЬз≥їзїЯжФѓжМБпЉМдЄНйЬАи¶БcpuеПВдЄОпЉМдїОиАМе∞СдЇЖдЄАжђ°еЖЕе≠Ше§НеИґгАВChunkedFileдЄїи¶БдљњзФ®fileзЪДread,readFullyз≠Й

APIпЉМиАМFileRegionдљњзФ®FileChannelзЪДtransferTo

APIпЉМ2иАЕеЃЮзО∞еєґдЄНе§НжЭВгАВZero-copyзЪДзЙєжАІињШжШѓеЊЧзЬЛжУНдљЬз≥їзїЯзЪДпЉМжЬђиЇЂдї£з†Бж≤°жЬЙеЊИе§ІзЪДзЙєеИЂдєЛе§ДгАВ

жЬАеРОжАїзїУдЄЛпЉМNettyзЪДжЮґжЮДжАЭжГ≥еТМзїЖиКВеПѓдї•иѓіиЃ©дЇЇзЬЉеЙНдЄАдЇЃпЉМеѓєдЇОjavaзљСзїЬIOзЪДеРДдЄ™ж≥®жДПзВєпЉМеПѓдї•иѓіNettyеЈ≤зїПиІ£еЖ≥еЊЧжѓФиЊГеЃМеЕ®дЇЖпЉМеРМжЧґ

Netty

зЪДдљЬиАЕдєЯжШѓеП¶е§ЦдЄАдЄ™NIOж°ЖжЮґMINAзЪДдљЬиАЕпЉМеЬ®еЃЮйЩЕдљњзФ®дЄ≠зІѓзіѓдЇЖдЄ∞еѓМзЪДзїПй™МпЉМдљЖжШѓжЬђжЦЗдєЯеП™жШѓдЄАдЄ™жЦ∞жЙЛеѓєдЇОNettyзЪДеИЭж≠•зРЖиІ£пЉМињШж≤°жЬЙиґ≥е§ЯзЪДиГљеКЫжМЗеЗЇжЯР

дЄАзїЖиКВзЪДжЙАеПСжМ•зЪДдљЬзФ®гАВ

зЫЄеЕ≥жО®иНР

Nettyдї£з†БеИЖжЮР жЈШеЃЭзљСзїЉеРИдЄЪеК°еє≥еП∞еЫҐйШЯеНЪеЃҐ

з§ЇдЊЛдї•пЉЪTCP/IPиЗ™еЃЪдєЙжК•жЦЗеНПиЃЃињЫи°МиІ£жЮРеИЖжЮРпЉМеЯЇдЇОеЄІе§іHEAD_DATA=0x76иІ£жЮРињЗз®ЛзЪДз§ЇдЊЛдї£з†БпЉМеєґеѓєжХ∞жНЃињЫи°Мз≤ШеМЕеИЖз¶їзЪДе§ДзРЖгАВз≤ШеМЕе§ДзРЖжЦєеЉПжЬЙдЄ§зІНпЉЪ1.иЗ™еЃЪдєЙжК•жЦЗеНПиЃЃ зДґеРОињЫи°Мз≤ШеМЕеИЖз¶їгАРж≠§з§ЇдЊЛдЄЇиѓ•иІ£еЖ≥жЦєж°ИгАС 2.зФ®netty...

赆йАБжЇРдї£з†БпЉЪreactor-netty-core-1.0.15-sources.jarпЉЫ 赆йАБMavenдЊЭиµЦдњ°жБѓжЦЗдїґпЉЪreactor-netty-core-1.0.15.pomпЉЫ еМЕеРЂзњїиѓСеРОзЪДAPIжЦЗж°£пЉЪreactor-netty-core-1.0.15-javadoc-APIжЦЗж°£-дЄ≠жЦЗ(зЃАдљУ)зЙИ.zipпЉЫ MavenеЭРж†ЗпЉЪ...

еЬ®зРЖиЃЇжЦєйЭҐпЉМиЃ≤иІ£дЇЖNettyзЪДйАїиЊСжЮґжЮДж®°еЮЛеТМж†ЄењГз±їеЇУзЪДиЃЊиЃ°еОЯзРЖпЉМиАМдЄФеѓєNettyеЬ®е§ІжХ∞жНЃгАБдЇТиБФзљСгАБжЄЄжИПи°МдЄЪзЪДеЇФзФ®ињЫи°МдЇЖжЈ±еЕ•еИЖжЮРпЉЫеЃЮжИШжЦєйЭҐпЉМдїОзђђдЄАдЄ™NettyеЕ•йЧ®з®ЛеЇПеИ∞зІБжЬЙеНПиЃЃж†ИзЪДиЃЊиЃ°еТМеЉАеПСпЉМйАЪињЗеЃЮйЩЕдЊЛз®ЛпЉМзФ±жµЕеЕ•жЈ±еЬ∞...

24_gRPCжХіеРИGradleдЄОдї£з†БзФЯжИР¬Ј¬Ј¬Ј¬Ј¬Ј¬Ј¬Ј¬Ј¬Ј¬Ј¬Ј¬Ј82_NettyеЉХзФ®иЃ°жХ∞еОЯе≠РжЫіжЦ∞жП≠зІШдЄОAtomicIntegerFieldUpdaterжЈ±еЇ¶еЙЦжЮРпЉЫ83_AtomicIntegerFieldUpdaterеЃЮдЊЛжЉФзїГдЄОvolatileеЕ≥йФЃе≠ЧеИЖжЮРпЉЫ84_NettyеЉХзФ®иЃ°жХ∞ж≥®жДПдЇЛй°єдЄО...

5_NettyжЙІи°МжµБз®ЛеИЖжЮРдЄОйЗНи¶БзїДдїґдїЛзїН 6_NettyеЫЮи∞ГдЄОChannelжЙІи°МжµБз®ЛеИЖжЮР 7_NettyзЪДSocketзЉЦз®Лиѓ¶иІ£ 8_Nettyе§ЪеЃҐжИЈзЂѓињЮжО•дЄОйАЪдњ° 9_NettyиѓїеЖЩж£АжµЛжЬЇеИґдЄОйХњињЮжО•и¶Бзі† 10_NettyеѓєWebSocketзЪДжФѓжПі 11_NettyеЃЮзО∞жЬНеК°еЩ®зЂѓдЄО...

Nettyе≠¶дє†зђФиЃ∞, еМЕжЛђдї£з†Бе≠¶дє†, жЇРз†БеИЖжЮР.еЯЇдЇОnetty4.1, зФ®дЇОиЃ∞ељХNettyе≠¶дє†ињЗз®ЛзЪДеРД зІНдњ°жБѓеТМењГеЊЧ

зђђ48иЃ≤пЉЪNettyдЄОNIOз≥їзїЯжАїзїУеПКNIOдЄОNettyдєЛйЧізЪДеЕ≥иБФеЕ≥з≥їеИЖжЮР зђђ49иЃ≤пЉЪйЫґжЛЈиіЭжЈ±еЕ•еЙЦжЮРеПКзФ®жИЈз©ЇйЧідЄОеЖЕж†Єз©ЇйЧіеИЗжНҐжЦєеЉП зђђ50иЃ≤пЉЪйЫґжЛЈиіЭеЃЮдЊЛжЈ±еЇ¶еЙЦжЮР зђђ51иЃ≤пЉЪNIOйЫґжЛЈиіЭељїеЇХеИЖжЮРдЄОGatherжУНдљЬеЬ®йЫґжЛЈиіЭдЄ≠зЪДдљЬзФ®иѓ¶иІ£ зђђ...

Java-NIO-Nettyж°ЖжЮґе≠¶дє†иµДжЇРзЫЃељХпЉЪгАРгАСNetty5.0жЮґжЮДеЙЦжЮРеТМжЇРз†БиІ£иѓїгАРгАСNetty5зФ®жИЈжМЗеНЧгАРгАСNetty_in_Action(зђђдЇФзЙИ-зЫЃељХдњЃж≠£зЙИ)гАРгАСNetty_in_Action_v08_MEAPгАРгАСNetty_in_Action_v10_MEAPгАРгАСNetty_дї£з†БеИЖжЮРгАРгАС...

еЬ®зРЖиЃЇжЦєйЭҐпЉМиЃ≤иІ£дЇЖNettyзЪДйАїиЊСжЮґжЮДж®°еЮЛеТМж†ЄењГз±їеЇУзЪДиЃЊиЃ°еОЯзРЖпЉМиАМдЄФеѓєNettyеЬ®е§ІжХ∞жНЃгАБдЇТиБФзљСгАБжЄЄжИПи°МдЄЪзЪДеЇФзФ®ињЫи°МдЇЖжЈ±еЕ•еИЖжЮРпЉЫеЃЮжИШжЦєйЭҐпЉМдїОзђђдЄАдЄ™NettyеЕ•йЧ®з®ЛеЇПеИ∞зІБжЬЙеНПиЃЃж†ИзЪДиЃЊиЃ°еТМеЉАеПСпЉМйАЪињЗеЃЮйЩЕдЊЛз®ЛпЉМзФ±жµЕеЕ•жЈ±еЬ∞...

зФ±дЇОињЩдЄ§дЄ™еОЯеЫ†пЉМжЬАеЉАеІЛжЧґпЉМзЬЛдї£з†БзЪДињЫеЇ¶еЊИжЕҐпЉМзФЪиЗ≥дЄАеЇ¶жГ≥жФЊеЉГдЇЖпЉМдЄНињЗжЬАеРОеЊИеЇЖеєЄиЗ™еЈ±иГље§ЯеЭЪжМБдЄЛеОїпЉМеєґеЫ†ж≠§дїОNettyжЇРз†БдЄ≠е≠¶еИ∞дЇЖеЊИе§ЪеЃЭиіµзЪДзЯ•иѓЖгАВдЄЛйЭҐжИСе∞ЖиЗ™еЈ±еЬ®NettyеОЯеІЛе≠¶дє†ињЗз®ЛиЃ∞ељХдЄЛжЭ•пЉМжХізРЖжИРеНЪеЃҐпЉМдЄОе§ІеЃґеИЖдЇЂ...

nettyеЃЮжИШPDFдЄ≠жЦЗзЙИ,1-13зЂ†йГљжЬЙ дЄ≠жЦЗзЙИ дєЛеЙНиІЙеЊЧnettyжЭГе®БжМЗеНЧдЄНйФЩ дљЖжШѓеЃЮиЈµдї•еРОеПСзО∞дЄНеѓє дї£з†БжЬЙйЧЃйҐШ жЮЬжЦ≠дє∞дЇЖињЩдЄ™ еИЖжЮРзїЩе§ІеЃґ еЄ¶зЫЃељХ

з≤ЊйАЪеєґеПСдЄОnettyиІЖйҐСжХЩз®Л(2018)иІЖйҐСжХЩз®Л nettyиІЖйҐСжХЩз®Л JavaиІЖйҐСжХЩз®ЛзЫЃељХпЉЪ 1_е≠¶дє†зЪДи¶БдєЙ 2_NettyеЃПиІВзРЖиІ£ 3_NettyиѓЊз®Ле§ІзЇ≤жЈ±еЇ¶иІ£иѓї 4_й°єзЫЃзОѓеҐГжР≠еїЇдЄОGradleйЕНзљЃ 5_NettyжЙІи°МжµБз®ЛеИЖжЮРдЄОйЗНи¶БзїДдїґдїЛзїН 6_NettyеЫЮи∞ГдЄО...

NettyжЇРз†БиІ£жЮР NettyжШѓJavaдЄЦзХМзЯ•еРНзЪДзљСзїЬеЇФзФ®ж°ЖжЮґгАВжЬђз≥їеИЧжЦЗзЂ†жШѓNettyзЪДжЇРз†БеѓЉиѓїгАВ дЄЇдїАдєИи¶БиѓїNettyжЇРз†БпЉЯ жИСиЃ§дЄЇпЉМдЄАиИђз†Фз©ґNettyжЇРз†БеЗЇдЇОдЄ§дЄ™еОЯеЫ†пЉЪ ...гАКNettyдї£з†БеИЖжЮРгАЛ by йШњйЗМдЄ≠йЧідїґеЫҐйШЯеНЪеЃҐ: http://jm

гАК NettyеЯЇз°АдЄОжЇРз†БеИЖжЮРгАЛжМБзї≠жЫіжЦ∞дЄ≠... жЬђжЦЗзїУеРИдЇЖгАК NettyжЭГе®БжМЗеНЧгАЛзЪДдЄАдЇЫзЯ•иѓЖзВєгАВ зЇЄдЄКеЊЧжЭ•зїИиІЙжµЕпЉМжЇРдї£з†БйГ®еИЖжЭ•иЗ™дЇОиЗ™еЈ±еѓєжЇРз†БзЪДиІ£иѓїпЉМеєґеК†дЄКдЄАдЇЫдЄїжµБеЉАжЇРж°ЖжЮґеѓєNettyдљњзФ®зЪДеЃЮиЈµгАВ дЄАпЉМLinuxзљСзїЬI / Oж®°еЮЛ 1пЉМ...

6пЉЙNettyжЇРз†БеИЖжЮР ByteBufеЈ•дљЬеОЯзРЖ Channel, Unsafe ChannelPipline, ChannelHandler EventLoop, EventLoopGroup Future, Promise 7) NettyйАїиЊСжЮґжЮД 8пЉЙNettyдЄ≠зЪДе§ЪзЇњз®ЛзЉЦз®Л 9пЉЙNettyдЄОRPC 10пЉЙNettyзЪДеПѓйЭ†жАІ ...

3гАБжЬђиµДжЇРдљЬдЄЇвАЬеПВиАГиµДжЦЩвАЭе¶ВжЮЬйЬАи¶БеЃЮзО∞еЕґдїЦеКЯиГљпЉМйЬАи¶БиГљзЬЛжЗВдї£з†БпЉМеєґдЄФзГ≠зИ±йТїз†ФпЉМиЗ™и°Ми∞ГиѓХгАВ еЯЇдЇОspringcloud+Netty+MQ+mysqlзЪДеИЖеЄГеЉПеН≥жЧґиБК姩з≥їзїЯжЇРз†Б+жХ∞жНЃеЇУ+й°єзЫЃиѓіжШО.zip # KT-Chat еИЖеЄГеЉПеН≥жЧґиБК姩з≥їзїЯ **жКАжЬѓ...

J2C е∞Ж Java дї£з†БиљђжИР C++ дї£з†БпЉМињЩжШѓжЇРз†БзЇІеИЂзЪДиљђжНҐпЉМиЊУеЗЇзЪД C++ дї£з†БжШѓжЬЙжХИзЪДдї£з†БгАВ OSGi еИЖеЄГеЉПйАЪиЃѓзїДдїґ R-OSGi R-OSGi жШѓдЄАе•ЧйАВзФ®дЇОдїїжДПжї°иґ≥ OSGi жЮґжЮДзЪДеИЖеЄГеЉПйАЪиЃѓзїДдїґгАВеЃГдї• jar зЪД嚥еЉПеПСеЄГпЉМйГ®зљ≤еЃєжШУпЉМдљњзФ®...

JavaдЇМињЫеИґIOз±їдЄОжЦЗдїґе§НеИґжУНдљЬеЃЮдЊЛ 16дЄ™зЫЃж†ЗжЦЗдїґ еЖЕ偺糥еЉХ:JavaжЇРз†Б,еИЭе≠¶еЃЮдЊЛ,дЇМињЫеИґ,жЦЗдїґе§НеИґ JavaдЇМињЫеИґIOз±їдЄОжЦЗдїґе§НеИґжУНдљЬеЃЮдЊЛпЉМе•љеГПжШѓдЄАжЬђдє¶зЪДдЊЛе≠РпЉМжЇРдї£з†БжЬЙзЪДжШѓзЛђзЂЛињРи°МзЪДпЉМдЄОеРМзЫЃељХдЄЛзЪДеЕґеЃГдї£з†БжЦЗдїґдЇТдЄНиБФз≥ї...