- 浏览: 472886 次

- 性别:

- 来自: 南阳

-

文章分类

最新评论

-

yuanhongb:

这么说来,感觉CGI和现在的JSP或ASP技术有点像啊

cgi -

draem0507:

放假了还这么勤啊

JXL操作Excel -

chenjun1634:

学习中!!

PHP/Java Bridge -

Jelen_123:

好文章,给了我好大帮助!多谢!

hadoop安装配置 ubuntu9.10 hadoop0.20.2 -

lancezhcj:

一直用job

Oracle存储过程定时执行2种方法(转)

开场白:

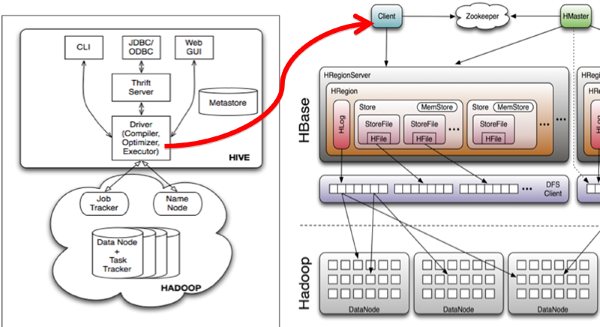

Hive与HBase的整合功能的实现是利用两者本身对外的API接口互相进行通信,相互通信主要是依靠hive_hbase-handler.jar工具类 (Hive Storage Handlers), 大致意思如图所示:

口水:

对 hive_hbase-handler.jar 这个东东还有点兴趣,有空来磋磨一下。

一、2个注意事项:

1、需要的软件有 Hadoop、Hive、Hbase、Zookeeper,Hive与HBase的整合对Hive的版本有要求,所以不要下载.0.6.0以前的老版本,Hive.0.6.0的版本才支持与HBase对接,因此在Hive的lib目录下可以看见多了hive_hbase-handler.jar这个jar包,他是Hive扩展存储的Handler ,HBase 建议使用 0.20.6的版本,这次我没有启动HDFS的集群环境,本次所有测试环境都在一台机器上。

2、运行Hive时,也许会出现如下错误,表示你的JVM分配的空间不够,错误信息如下:

Invalid maximum heap size: -Xmx4096m

The specified size exceeds the maximum representable size.

Could not create the Java virtual machine.

解决方法:

/work/hive/bin/ext# vim util/execHiveCmd.sh 文件中第33行

修改,

HADOOP_HEAPSIZE=4096

为

HADOOP_HEAPSIZE=256

另外,在 /etc/profile/ 加入 export $HIVE_HOME=/work/hive

二、启动运行环境

1启动Hive

hive –auxpath /work/hive/lib/hive_hbase-handler.jar,/work/hive/lib/hbase-0.20.3.jar,/work/hive/lib/zookeeper-3.2.2.jar -hiveconf hbase.master=127.0.0.1:60000

加载 Hive需要的工具类,并且指向HBase的master服务器地址,我的HBase master服务器和Hive运行在同一台机器,所以我指向本地。

2启动HBase

/work/hbase/bin/hbase master start

3启动Zookeeper

/work/zookeeper/bin/zkServer.sh start

三、执行

在Hive中创建一张表,相互关联的表

CREATE TABLE hbase_table_1(key int, value string) STORED BY 'org.apache.hadoop.hive.hbase.HBaseStorageHandler' WITH SERDEPROPERTIES ("hbase.columns.mapping" = ":key,cf1:val") TBLPROPERTIES ("hbase.table.name" = "xyz");

在运行一个在Hive中建表语句,并且将数据导入

建表

CREATE TABLE pokes (foo INT, bar STRING);

数据导入

LOAD DATA LOCAL INPATH '/work/hive/examples/files/kv1.txt' OVERWRITE INTO TABLE pokes;

在Hive与HBase关联的表中 插入一条数据

INSERT OVERWRITE TABLE hbase_table_1 SELECT * FROM pokes WHERE foo=98;

运行成功后,如图所示:

插入数据时采用了MapReduce的策略算法,并且同时向HBase写入,如图所示:

在HBase shell中运行 scan 'xyz' 和describe "xyz" 命令,查看表结构,运行结果如图所示:

xyz是通过Hive在Hbase中创建的表,刚刚在Hive的建表语句中指定了映射的属性 "hbase.columns.mapping" = ":key,cf1:val" 和 在HBase中建表的名称 "hbase.table.name" = "xyz"

在hbase在运行put命令,插入一条记录

put 'xyz','10001','cf1:val','www.javabloger.com'

在hive上运行查询语句,看看刚刚在hbase中插入的数据有没有同步过来,

select * from hbase_table_1 WHERE key=10001;

如图所示:

最终的效果

以上整合过程和操作步骤已经执行完毕,现在Hive中添加记录HBase中有记录添加,同样你在HBase中添加记录Hive中也会添加, 表示Hive与HBase整合成功,对海量级别的数据我们是不是可以在HBase写入,在Hive中查询 喃?因为HBase 不支持复杂的查询,但是HBase可以作为基于 key 获取一行或多行数据,或者扫描数据区间,以及过滤操作。而复杂的查询可以让Hive来完成,一个作为存储的入口(HBase),一个作为查询的入口(Hive)。如下图示。

呵呵,见笑了,以上只是我面片的观点。

http://www.blogjava.net/ivanwan/archive/2011/01/10/342685.html

===========================================================

一 、简介

Hive是基于Hadoop的一个数据仓库工具,可以将结构化的数据文件映射为一张数据库表,并提供完整的sql查询功能,可以将sql语句转换为MapReduce任务进行运行。 其优点是学习成本低,可以通过类SQL语句快速实现简单的MapReduce统计,不必开发专门的MapReduce应用,十分适合数据仓库的统计分析。

Hive与HBase的整合功能的实现是利用两者本身对外的API接口互相进行通信,相互通信主要是依靠hive_hbase-handler.jar工具类, 大致意思如图所示:

二、安装步骤:

1 .Hadoop和Hbase都已经成功安装了

Hadoop集群配置:http://blog.csdn.net/hguisu/article/details/723739

hbase安装配置:http://blog.csdn.net/hguisu/article/details/7244413

2 . 拷贝hbase-0.90.4.jar和zookeeper-3.3.2.jar到hive/lib下。

注意:如何hive/lib下已经存在这两个文件的其他版本(例如zookeeper-3.3.2.jar),建议删除后使用hbase下的相关版本。

2. 修改hive/conf下hive-site.xml文件,在底部添加如下内容:

- <!--

- <property>

- <name>hive.exec.scratchdir</name>

- <value>/usr/local/hive/tmp</value>

- </property>

- -->

- <property>

- <name>hive.querylog.location</name>

- <value>/usr/local/hive/logs</value>

- </property>

- <property>

- <name>hive.aux.jars.path</name>

- <value>file:///usr/local/hive/lib/hive-hbase-handler-0.8.0.jar,file:///usr/local/hive/lib/hbase-0.90.4.jar,file:///usr/local/hive/lib/zookeeper-3.3.2.jar</value>

- </property>

注意:如果hive-site.xml不存在则自行创建,或者把hive-default.xml.template文件改名后使用。

3. 拷贝hbase-0.90.4.jar到所有hadoop节点(包括master)的hadoop/lib下。

4. 拷贝hbase/conf下的hbase-site.xml文件到所有hadoop节点(包括master)的hadoop/conf下。

注意,如果3,4两步跳过的话,运行hive时很可能出现如下错误:

- [html] view plaincopy

- org.apache.hadoop.hbase.ZooKeeperConnectionException: HBase is able to connect to ZooKeeper but the connection closes immediately.

- This could be a sign that the server has too many connections (30 is the default). Consider inspecting your ZK server logs for that error and

- then make sure you are reusing HBaseConfiguration as often as you can. See HTable's javadoc for more information. at org.apache.hadoop.

- hbase.zookeeper.ZooKeeperWatcher.

三、启动Hive

1.单节点启动

#bin/hive -hiveconf hbase.master=master:490001

2 集群启动:

#bin/hive -hiveconf hbase.zookeeper.quorum=node1,node2,node3

如何hive-site.xml文件中没有配置hive.aux.jars.path,则可以按照如下方式启动。

bin/hive --auxpath /usr/local/hive/lib/hive-hbase-handler-0.8.0.jar, /usr/local/hive/lib/hbase-0.90.5.jar, /usr/local/hive/lib/zookeeper-3.3.2.jar -hiveconf hbase.zookeeper.quorum=node1,node2,node3

四、测试:

1.创建hbase识别的数据库:

- CREATE TABLE hbase_table_1(key int, value string)

- STORED BY 'org.apache.hadoop.hive.hbase.HBaseStorageHandler'

- WITH SERDEPROPERTIES ("hbase.columns.mapping" = ":key,cf1:val")

- TBLPROPERTIES ("hbase.table.name" = "xyz");

hbase.table.name 定义在hbase的table名称

hbase.columns.mapping 定义在hbase的列族

2.使用sql导入数据

1) 新建hive的数据表:

CREATE TABLE pokes (foo INT, bar STRING);

2)批量插入数据:

hive> LOAD DATA LOCAL INPATH './examples/files/kv1.txt' OVERWRITE INTO TABLE

3)使用sql导入hbase_table_1:

hive> INSERT OVERWRITE TABLE hbase_table_1 SELECT * FROM pokes WHERE foo=86;

3. 查看数据

hive> select * from hbase_table_1;

这时可以登录Hbase去查看数据了

#bin/hbase shell

hbase(main):001:0> describe 'xyz'

hbase(main):002:0> scan 'xyz'

hbase(main):003:0> put 'xyz','100','cf1:val','www.360buy.com'

这时在Hive中可以看到刚才在Hbase中插入的数据了。

4 hive访问已经存在的hbase

使用CREATE EXTERNAL TABLE:

- CREATE EXTERNAL TABLE hbase_table_2(key int, value string)

- STORED BY 'org.apache.hadoop.hive.hbase.HBaseStorageHandler'

- WITH SERDEPROPERTIES ("hbase.columns.mapping" = "cf1:val")

- TBLPROPERTIES("hbase.table.name" = "some_existing_table");

内容参考:http://wiki.apache.org/hadoop/Hive/HBaseIntegration

发表评论

-

mysql 定时任务

2015-11-03 09:57 732定时任务 查看event是否开启: show variabl ... -

tomcat服务器大数量数据提交Post too large解决办法

2015-10-29 11:05 702tomcat默认设置能接收HTTP POST请求的大小最大 ... -

Tomcat启动内存设置

2015-10-20 15:40 635Tomcat的启动分为startupo.bat启动和注册为w ... -

Java串口包Javax.comm的安装

2015-10-12 16:32 656安装个java的串口包安装了半天,一直找不到串口,现在终于搞 ... -

在 Java 应用程序中访问 USB 设备

2015-10-10 17:49 913介绍 USB、jUSB 和 JSR- ... -

mysql定时器

2015-08-04 14:01 5645.1以后可以使用 ALTER EVENT `tes ... -

oracle安装成功后,更改字符集

2015-07-23 11:53 598看了网上的文章,乱码有以下几种可能 1. 操作系统的字符集 ... -

运用navicat for mysql实现定时备份

2015-06-05 15:02 1049使用navicat for mysql实现定时备份 首 ... -

利用html5调用本地摄像头拍照上传图片

2015-05-18 09:36 2571测试只有PC上可以,手机上不行 <!DOCTYPE ... -

必须Mark!最佳HTML5应用开发工具推荐

2015-05-15 22:50 926摘要:HTML5自诞生以来,作为新一代的Web标准,越来 ... -

Mobl试用二

2015-05-13 14:28 601最近有空又看了一下Mobl的一些说语法,备忘一下: 1 ... -

Nginx配置文件详细说明

2015-05-08 19:58 574在此记录下Nginx服务器nginx.conf的配置文件说明 ... -

axis调用cxf

2015-04-23 13:51 5161、写address时不用加?wsdl Service s ... -

Oracle10g数据文件太大,导致C盘空间不够用的解决方法

2015-03-19 15:22 880由于在安装的时候将Oracle安装到了C盘,表空间也创建到了C ... -

mysql 获取第一个汉字首字母

2015-03-18 17:48 590select dmlb, dmz, dmsm1, CHAR ... -

failed to install Tomcat6 service解决办法

2015-02-12 09:20 494最近我重装了一下tomcat 6.0,可不知为什么,总是安装 ... -

tomcat 分配java内存

2015-02-11 10:37 556//首先检查程序有没有限入死循环 这个问题主要还是由这个问 ... -

[Android算法] Android蓝牙开发浅谈

2014-12-15 15:27 626对于一般的软件开发人 ... -

Android 内存溢出解决方案(OOM) 整理总结

2014-11-21 10:12 706原创作品,允许转载,转载时请务必以超链接形式标明文章 原始出 ... -

《HTML5从入门到精通》中文学习教程 PDF

2014-11-19 21:26 1088HTML5 草案的前身名为Web Applications ...

相关推荐

Hadoop Hive与Hbase整合配置

hive与hbase整合经验谈

大数据工具篇之Hive与HBase整合完整教程

Hive与hbase的结构,Hive与hbase整合后的结构图 , Hive与hbase整合的原理

配置,测试,导入数据详细操作,CREATE TABLE hive_hbase_table(key int, value string,name string) hadoop jar /usr/lib/hbase/hbase-0.90.4-cdh3u3.jar importtsv -Dimporttsv.columns=HBASE_ROW_KEY, catgyname...

Hive与Hbase的整合,集中两者的优势,使用HiveQL语言,同时具备了实时性

hive和hbase整合的时候,如果出现不兼容的情况需要手动编译:hive-hbase-hander-1.2.2.jar把这个jar替换掉hive/lib里的那个jar包

此文档是本人在工作中用到的知识总结出来的整合过程,本人是菜鸟,希望得到大神们的建议。

HBase2.1.3整合Hive3.1.2,Hive官方的hive-hbase-handler-3.1.1.jar包不好用,自己编译后的,确认好用

hive和hbase的整合所需要的编译后的jar包。 注意:这里的hbase版本为:1.2.1 hive的版本为:1.2.1

1、内容概要:Hadoop+Spark+Hive+HBase+Oozie+Kafka+Flume+Flink+Elasticsearch+Redash等大数据集群及组件搭建指南(详细搭建步骤+实践过程问题总结)。 2、适合人群:大数据运维、大数据相关技术及组件初学者。 3、...

jdk1.8.0_131、apache-zookeeper-3.8.0、hadoop-3.3.2、hbase-2.4.12 mysql5.7.38、mysql jdbc驱动mysql-connector-java-8.0.8-dmr-bin.jar、 apache-hive-3.1.3 2.本文软件均安装在自建的目录/export/server/下 ...

HBase是建立在HDFS上的面上列的数据库。...hive是基于Hadoop的一个数据仓库工具,可以将结构化的数据文件映射为一张数据库表,并提供简单的sql查询功能,可以将sql语句转换为MapReduce任务进行运行。

mapreduce方式入库hbase hive hdfs,速度很快,里面详细讲述了代码的编写过程,值得下载

hadoop,hbase,hive版本整合兼容性最全,最详细说明【适用于任何版本】,避免下载后才发现不兼容的坑

个或多个维表没有直接连接到事实表上,而是通过其他维表连接到事实表上时,其图解就像多个雪花连接在一起,故称雪花模型。雪花模型是对星型模型的扩展。它对星型模型的维表进一步层次化,原有的各维表可能被扩展为小...

https://blog.csdn.net/m0_51197424/article/details/117046572